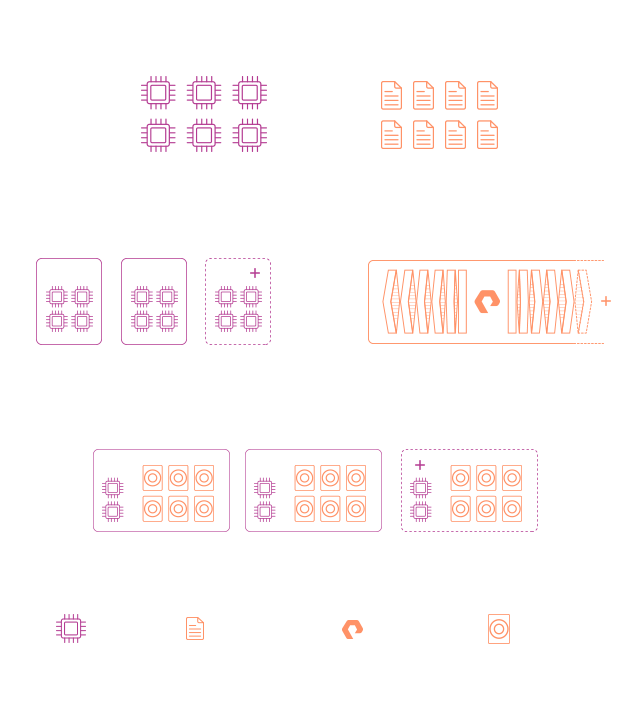

Hébergement

Big Data

Vous l’avez peut-être appris à vos dépens ou grâce à votre expérience sur les projets Big Data. Si vous lisez ces lignes, vous savez pertinemment que l’hébergement est une des pierres angulaires de la performance des solutions Big Data.

Mais contrairement aux soupes, ce ne sont pas dans les vieux pots que l’on obtient les meilleures performances. Nous avons donc repoussé les limites de l’hébergement pour concevoir une offre dédiée aux projets Big Data. Cette offre s’adresse aux entreprises qui ont un projet Big Data défini et qui souhaitent :

- Être intransigeantes sur les niveaux de performances

- Déléguer les contraintes techniques pour se concentrer sur leurs jobs (et leurs métiers)

- Challenger l’hébergement inclus dans les offres packagées

Nous savons que les projets Big Data sont sensibles et que les moindres changements peuvent être sources de complication voire de stress. C’est pourquoi nous vous accompagnerons à chaque étape de la construction de votre plateforme. Vous pourrez même la tester gratuitement pendant trois mois pour vérifier que tout fonctionne comme vous le souhaitez.

Envie de nous mettre à l’épreuve et constater par vous-même pourquoi nous sommes si sûrs de nous ?

E-mail

E-mail

Téléphone

Téléphone